“为速度而生的前沿智能”,12月18日凌晨,谷歌发布博客,官宣又一王炸Gemini3Flash,这是Gemini3系列速度最快、性价比最高的模型,也是但同时,这次被行业关注的点在于,这个Flash模型在做到又快又便宜的同时,部分性能甚至能比旗舰模型要好。

值得注意的是,这也是谷歌一个月内在大模型领域的第四次动作更新。

谷歌CEO桑达尔·皮查伊(SundarPichai)发帖介绍,Gemini3Flash性能和效率均突破了帕累托极限,它的性能超越了上一代旗舰模型2.5Pro,同时速度提升了3倍,而价格却低得多。

“Gemini3Flash证明,速度和规模无需以牺牲智能为代价。”在博客中,官方放出豪言。从评测数据来看确实如此。

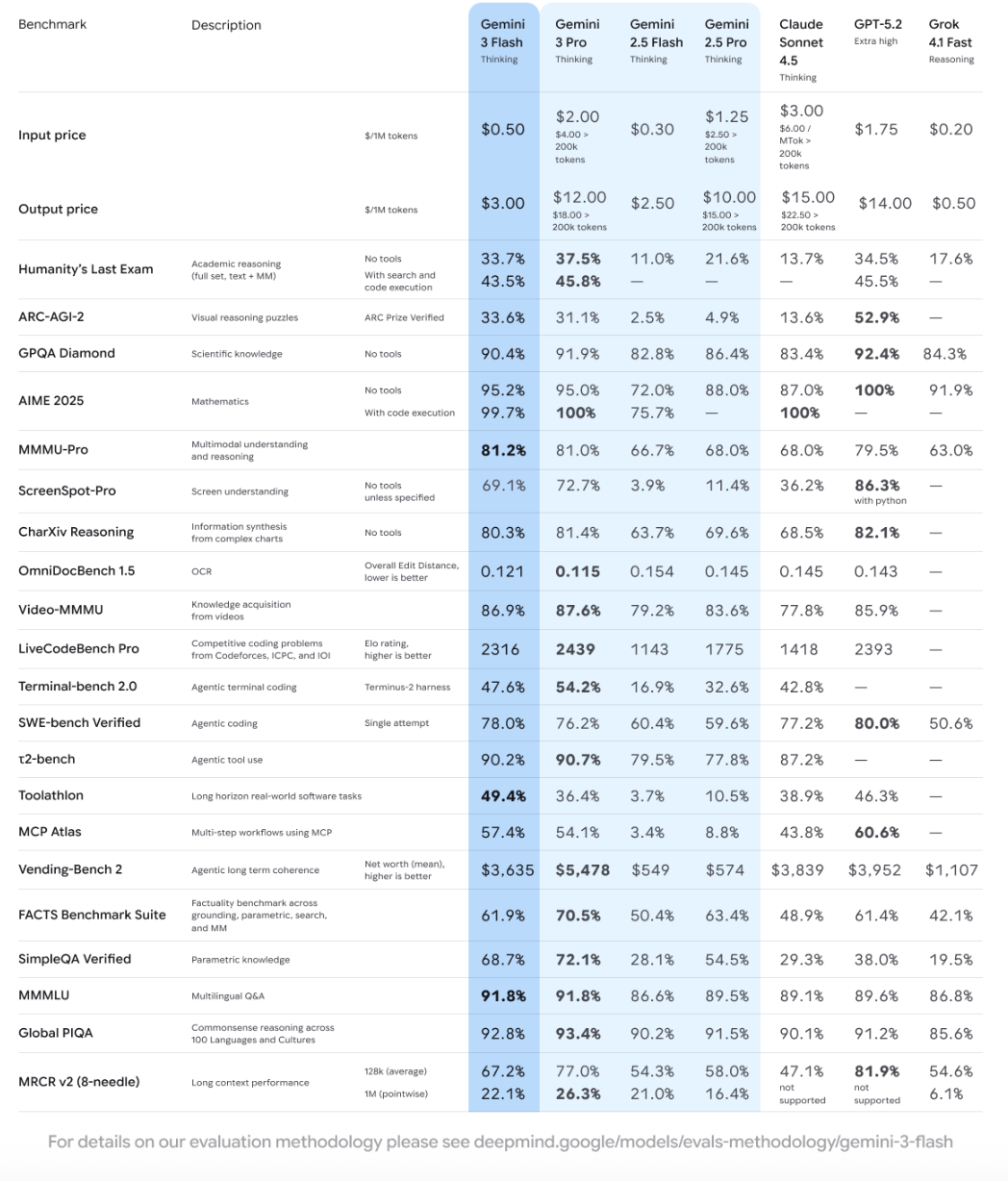

在用于评估编程能力的基准测试SWE-benchVerified中,Gemini3Flash的得分高达78%,超越了自家的旗舰模型Gemini3Pro和Anthropic旗下的ClaudeSonnet4.5;在多模态理解基准MMMU-Pro上,Flash得分81.2%,不仅超过GPT-5.2(79.5%),还甩开ClaudeSonnet4.5十几个百分点。

种种数据表明,这次的Flash模型进步很大,突破了用户印象里的轻量化模型:快、便宜,但是性能往往会打折。而Gemini3Flash做到了接近旗舰的能力,同时满足效率和性价比。

根据大模型竞技场Imarena.ai的数据,目前Gemini3Flash在文本、图像和编程领域排名前5,数学和创意写作类别排名第2,是性价比最高的前沿模型,输入仅0.5美元/百万Tokens,输出3美元/百万Tokens。

作为对比,ClaudeSonnet4.5的输出是15美元/百万Tokens,GPT-5.2的输出是14美元/百万Tokens,是Gemini3Flash定价的近5倍。

谷歌表示,在最高思维水平下进行处理时,Gemini3Flash能够灵活调整其思考时间。对于更复杂的应用场景,它可能需要更长的思考时间,但根据典型流量的测试结果,它平均使用的令牌数量会比上一代的2.5Pro少30%,从而以更高的性能更准确地完成日常任务。

Gemini3Flash保留了Gemini3在复杂推理、多模态、智能体和编程任务方面的突破性性能,同时结合了Flash级别的延迟、效率和成本优势相结合。“这是迄今为止在智能体工作流程方面最出色的模型。”谷歌称。

一位开发者用Gemini3Flash和“两个性价比之王”做了Python对比测试,其中一个是OpenAI的性价比版本GPT-5Mini、一个是国产开源之光DeepSeek-V3.2。

结果显示,成本上三个模型差不多,但是速度上Gemini3Flash只要9秒,而GPT-5Mini、DeepSeek-V3.2分别用了35秒和41秒,同时效果上Gemini3Flash胜出,这是一个平衡了速度和性能的模型。

“更快、更便宜、还能免费用,这才是独立开发者和小团队真正需要的东西。”一位独立开发者发文表示,如果之前是用GPT-4o或Gemini3Pro跑应用,换成Gemini3Flash,成本预计能直接降50%-70%。

从今天起,Gemini3Flash将面向所有用户推出,即便是免费用户也能用上,在GeminiApp里,Gemini3Flash会替代2.5Flash成为新的默认模型,而Gemini3Pro则是留给用户处理高难度数学和代码问题的一个选择。

上个月,谷歌推出了Gemini3Pro和Gemini3DeepThink,获得了广泛的市场认可,并反超OpenAI成为大模型领域的领先者。博客提到,自发布以来,内部的API每天处理超过1万亿个tokens。用户经常使用Gemini3进行代码模拟,学习复杂的主题,构建和设计交互式游戏,并理解各种类型的多模态内容。

凭借性价比和性能,此次推出的Flash预计将受到更大程度上的欢迎,谷歌表示,Flash一直是内部最受欢迎的版本,此前的Flash2和Flash2.5处理着数百万开发者构建的数十万个应用程序中数万亿个tokens。

“Flash模型真正为开发者量身打造,而Flash3则让他们无需再在速度和智能之间做出妥协。”谷歌又一张王牌露出,留给OpenAI应战的时间不多了。

本文内容由互联网用户自发贡献,该文观点仅代表作者本人。如发现本站有涉嫌抄袭侵权/违法违规的内容,请发送邮件至 203304862@qq.com

本文链接:https://www.jinnalai.com/jiaodian/797358.html