微软与谷歌周四同步发布新一代AI模型,进一步加码多模态能力布局。微软推出自研MAI系列基础模型,覆盖语音转写、语音生成和图像生成,并加速融入自家产品体系;谷歌则发布Gemma4开源模型,主打本地运行和多模态能力,并将许可切换至更开放的Apache2.0协议。

微软:三款MAI模型覆盖语音与图像能力

微软推出的“世界级”自研MAI模型,一共包括三款:

首先是MAI-Transcribe-1,这是一款“最先进”的语音转文本模型,能够理解全球使用最广泛的25种语言,其批量转录速度相比微软现有的AzureFast方案提升了2.5倍。MAI-Transcribe-1的起步价格为每小时0.36美元。

其次是MAI-Voice-1,这是一款新的语音生成模型,只需1秒即可生成60秒的音频。同时,它还支持在MicrosoftFoundry中通过短音频样本创建定制语音。MAI-Voice-1的起步价格为每100万个字符22美元。

最后是MAI-Image-2,这是一款更快的文生图模型,目前已经开始在Copilot中上线,接下来将陆续应用于Bing和PowerPoint。MAI-Image-2的价格为文本输入每100万个词元(Token)收费5美元,图像输出每100万个词元收费33美元。

如今,这三款模型已全部在MicrosoftFoundry上线,其中语音转写和语音生成模型也可在MAIPlayground中使用。这些模型由微软的MAI超级智能团队开发,该团队由MicrosoftAI首席执行官穆斯塔法·苏莱曼(MustafaSuleyman)领导,于2025年11月成立并对外公布。

微软表示:

媒体分析称,这一发布表明,尽管微软仍与OpenAI保持紧密合作,但公司正持续推进构建自有多模态AI模型体系,并与其他AI研究机构展开竞争。

不过,苏莱曼在接受媒体采访时重申,微软仍将继续与OpenAI保持合作关系。但他也向媒体表示,近期对双方合作关系的重新谈判,使微软能够真正推进其超级智能研究。

微软已向OpenAI投资超过130亿美元,并通过一项多年期合作,将其模型部署在自家多款产品中。微软在芯片领域也采取类似策略:既自主研发,也同时采购外部供应商的产品。

谷歌:Gemma4开源模型主打本地运行与多模态能力

谷歌推出的Gemma4开源模型采用Apache2.0许可,而不再使用此前自定义的Gemma许可协议。谷歌表示,这些模型具备高级推理能力、代理式工作流、代码生成,以及视觉和音频生成能力,并提供四种不同版本,针对本地运行进行了优化,甚至可以运行在“数十亿台安卓设备”上。

谷歌表示:

四种不同版本主要区别在于参数规模。针对边缘设备(包括智能手机),公司推出了20亿和40亿参数的“Effective”模型,更注重多模态能力和低延迟处理,适用于移动设备和物联网设备。针对更强大的设备,则提供了260亿参数的“MixtureofExperts”(专家混合)模型,以及310亿参数的“Dense”(稠密)模型,旨在运行于消费级GPU上,可用于驱动IDE、编程助手以及代理式工作流。这些模型还支持完全离线运行。

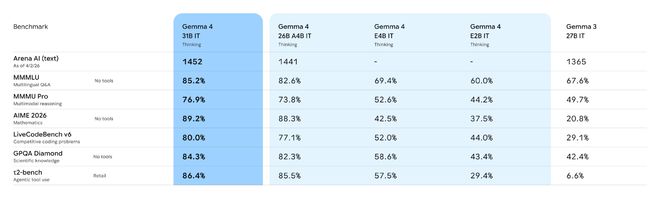

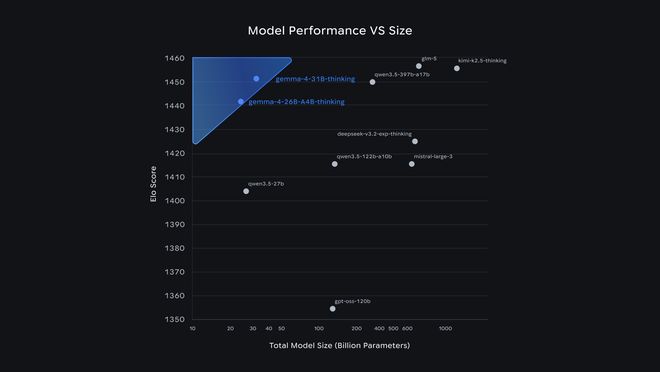

谷歌表示,在Gemma4上实现了“前所未有的单位参数智能水平”。为佐证这一说法,公司指出,Gemma4中310亿和260亿参数版本在ArenaAI文本排行榜上分别位列第三和第六,击败了规模是其20倍的模型。

所有这些模型都可以处理视频和图像,因此非常适合用于光学字符识别等任务。较小的两个模型还支持处理音频输入并理解语音。此外,谷歌表示,Gemma4系列支持离线代码生成,这意味着用户可以在没有互联网连接的情况下进行编程(例如进行“vibecoding”)。这些模型还支持超过140种语言。

谷歌的Gemma4开源模型可以在多个平台下载,包括HuggingFace、Kaggle和Ollama。谷歌强调:

本文内容由互联网用户自发贡献,该文观点仅代表作者本人。如发现本站有涉嫌抄袭侵权/违法违规的内容,请发送邮件至 203304862@qq.com

本文链接:https://jinnalai.com/jiaodian/819774.html